Schimbarea de accent vine pe măsură ce inferența devine un nou câmp de bătălie în industria AI: Nvidia rămâne liderul incontestabil la antrenarea modelelor mari, însă tot mai multe aplicații comerciale pun presiune pe viteză și cost atunci când milioane de utilizatori cer răspunsuri în timp real.

Negocierile Nvidia-OpenAI, tot mai complicate

Eforturile OpenAI de a diversifica hardware-ul pentru inferență apar în timp ce cele două companii discută o investiție majoră. În septembrie, Nvidia anunțase intenția de a investi până la 100 de miliarde de dolari în OpenAI, într-o tranzacție care ar fi oferit producătorului de cipuri o participație, iar OpenAI finanțarea necesară pentru a cumpăra hardware avansat. Tranzacția era așteptată să se închidă rapid, însă negocierile s-au prelungit cu luni.

Între timp, OpenAI a încheiat acorduri cu AMD și alți furnizori pentru unități GPU menite să concureze cu oferta Nvidia, iar schimbările din „foaia de parcurs” a produselor OpenAI au modificat tipul de resurse de calcul necesare, un factor care, potrivit unei surse, a îngreunat discuțiile cu Nvidia.

Sâmbătă, directorul executiv al Nvidia, Jensen Huang, a respins ideea unor tensiuni cu OpenAI, catalogând-o drept „nonsens” și insistând că Nvidia plănuiește o investiție substanțială în companie. Nvidia a transmis, într-un comunicat, că „clienții continuă să aleagă NVIDIA pentru inferență” datorită performanței și costului total de utilizare la scară mare. Separat, OpenAI a spus că se bazează pe Nvidia pentru „marea majoritate” a flotei sale de inferență și că soluțiile Nvidia oferă cel mai bun raport performanță/dolar pentru această etapă.

De ce contează „inferența” și unde acuză OpenAI întârzieri

Potrivit surselor Reuters, OpenAI nu este mulțumită de viteza cu care unele configurații Nvidia pot „servi” răspunsuri pentru anumite tipuri de solicitări — în special în zone precum dezvoltarea software și integrarea AI cu alte aplicații. Compania ar urmări ca viitorul hardware alternativ să acopere, în timp, aproximativ 10% din necesarul său de calcul pentru inferență.

Tema ar fi devenit vizibilă intern în Codex, produsul OpenAI pentru generarea de cod, pe care compania îl promovează agresiv. Unele echipe ar fi pus parte din „slăbiciuni” pe seama limitărilor hardware bazat pe GPU în anumite scenarii.

Pe 30 ianuarie, CEO-ul OpenAI, Sam Altman, a subliniat că utilizatorii modelelor de programare „pun un mare premium pe viteză” pentru munca de coding – o presiune diferită față de utilizarea casual a chatbot-ului.

Miza tehnică: mai multă memorie „pe cip” (SRAM)

Căutarea OpenAI s-a concentrat pe companii care dezvoltă cipuri cu cantități mari de memorie integrate direct în aceeași bucată de siliciu (SRAM), ceea ce poate accelera răspunsurile pentru chatboți și sisteme AI care procesează simultan un volum uriaș de cereri.

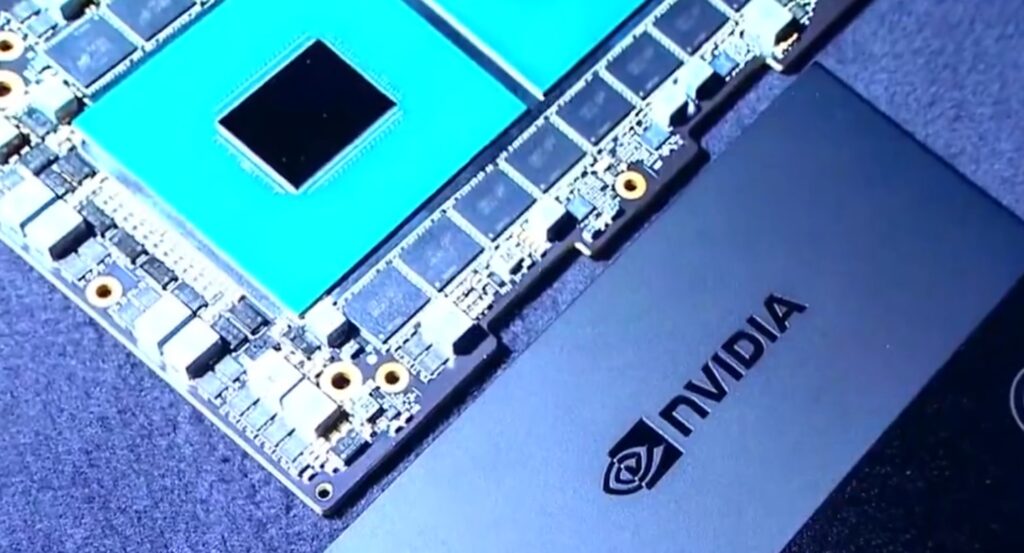

Sursele citate explică diferența astfel: la inferență, cipul petrece relativ mai mult timp accesând date din memorie decât făcând operații matematice. GPU-urile Nvidia (și multe soluții similare) se bazează pe memorie externă, ceea ce poate adăuga latență și reduce „snappiness”-ul resimțit de utilizatori.

Cerebras și Groq, pe radar — iar Nvidia se mișcă rapid

OpenAI ar fi discutat colaborări cu start-up-uri precum Cerebras și Groq pentru inferență mai rapidă. Însă, potrivit uneia dintre surse, discuțiile cu Groq au fost stopate după ce Nvidia a semnat un acord de licențiere evaluat la 20 de miliarde de dolari pentru tehnologia Groq.

În paralel, pe măsură ce OpenAI își făcea cunoscute rezervele, Nvidia ar fi abordat companii care lucrează la cipuri „SRAM-heavy”, inclusiv Cerebras și Groq, privind o posibilă achiziție. Cerebras ar fi refuzat și a anunțat luna trecută un acord comercial cu OpenAI.

Concurența împinge piața spre soluții dedicate

Rivali precum Anthropic (cu Claude) și Google (cu Gemini) beneficiază de implementări care folosesc mai intens cipuri dezvoltate intern (TPU), proiectate special pentru calculele de inferență, ceea ce poate oferi avantaje față de cipurile mai generaliste.